¿Qué es la explicabilidad («explainability») en Inteligencia Artificial?

A medida que los sistemas de inteligencia artificial (IA) se integran en nuestras vidas ( desde recomendar películas hasta aprobar préstamos o detectar fraudes ) es cada vez más importante que entendamos cómo y por qué tomaron estas decisiones.

En este punto entra el concepto de «explainability» o explicabilidad, del cual considero interesante abordar algunos aspectos.

¿Por qué es importante?

Muchos modelos de IA, especialmente los más avanzados como las redes neuronales profundas, funcionan como una especie de «caja negra» (es decir, procesan enormes cantidades de datos y devuelven un resultado), pero sin explicar claramente qué ocurrió en el proceso. Esto puede ser un problema cuando esas decisiones afectan directamente a las personas.

Ejemplo : Solicitud de préstamo

Imagina que solicitas un préstamo a tu banco y te lo niegan. Si esa decisión la tomó una IA, la explicabilidad permite que el banco te diga algo como:

“La solicitud fue rechazada porque tu historial de pagos muestra atrasos frecuentes y tus ingresos mensuales están por debajo del umbral requerido.”

Sin explicabilidad, solo recibirías un “no” sin razones claras, lo cual puede parecer injusto o discriminatorio.

¿Qué aporta la explicabilidad?

Desde el punto de vista de los interesados en IA, podemos plantear que aporta :

- Transparencia: Las personas pueden entender cómo funciona el sistema.

- Confianza: Es más fácil confiar en una IA si sabemos cómo razona.

- Responsabilidad: Se pueden detectar errores, sesgos o decisiones injustas.

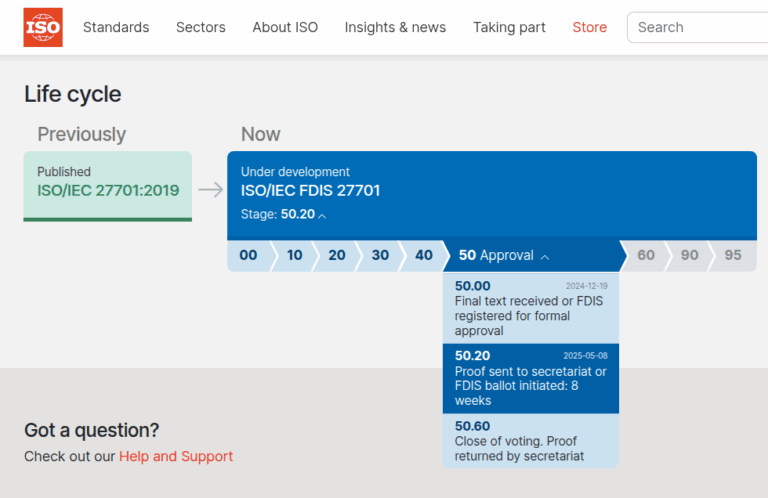

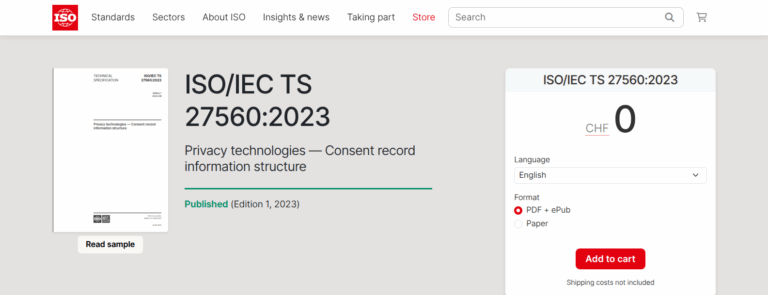

- Cumplimiento legal: Algunas regulaciones exigen que las decisiones automatizadas sean explicables.

Ejemplo : Diagnóstico médico con IA

Un hospital usa un sistema de IA para ayudar a diagnosticar enfermedades. Si la IA indica que un paciente podría tener una afección pulmonar, la explicabilidad permite saber que esta conclusión se basó en:

- La forma y tamaño de ciertas áreas en una radiografía.

- Síntomas reportados por el paciente.

- Comparación con miles de casos similares anteriores.

Esto permite que los médicos validen o cuestionen la decisión, en lugar de aceptar un “veredicto” sin fundamento visible.

¿Cómo se logra la explicabilidad?

Algunos métodos incluyen:

- Modelos más simples y comprensibles (como árboles de decisión o reglas).

- Herramientas visuales que muestran qué partes de una imagen o qué datos influyeron más en la decisión.

- Resúmenes en lenguaje natural, que explican de forma sencilla los motivos detrás de una predicción.

En resumen

La explicabilidad en IA no se trata solo de entender la tecnología, sino de hacerla humana, justa y confiable. Nos ayuda a mantener el control, especialmente cuando las decisiones automáticas tienen un impacto real ( y lo tendrán cada vez mas ) en nuestras vidas.

Puede ver este post en linkedin en : https://www.linkedin.com/pulse/qu%C3%A9-es-la-explicabilidad-explainability-en-artificial-horna-vallejos-wmzpe